Svrha regresione analize je mjerenje odnosa između zavisne varijable i jedne (parna regresiona analiza) ili više (više) nezavisnih varijabli. Nezavisne varijable se takođe nazivaju faktorske, eksplanatorne, determinantne, regresorske i prediktorske varijable.

Zavisna varijabla se ponekad naziva određena, objašnjena ili “odgovorna” varijabla. Izuzetno rasprostranjena upotreba regresione analize u empirijskim istraživanjima nije samo zbog činjenice da je ona pogodan alat za testiranje hipoteza. Regresija, posebno višestruka regresija, jeste efikasan metod modeliranje i predviđanje.

Počnimo objašnjavati principe rada s regresijskom analizom jednostavnijom - metodom parova.

Uparena regresijska analiza

Prvi koraci pri korištenju regresione analize bit će gotovo identični onima koje smo poduzeli pri izračunavanju koeficijenta korelacije. Za višestruku regresiju relevantna su i tri glavna uslova za efikasnost korelacione analize korišćenjem Pirsonove metode – normalna distribucija varijabli, intervalno merenje varijabli, linearni odnos između varijabli. Shodno tome, u prvoj fazi se konstruišu dijagrami raspršenja, vrši se statistička i deskriptivna analiza varijabli i izračunava regresijska linija. Kao iu okviru korelacione analize, regresijske linije se konstruišu metodom najmanjih kvadrata.

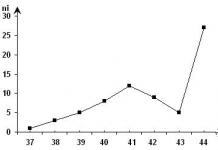

Da bismo jasnije ilustrovali razlike između ove dvije metode analize podataka, okrenimo se primjeru o kojem smo već govorili s varijablama “SPS podrška” i “udio ruralnog stanovništva" Izvorni podaci su identični. Razlika u dijagramima raspršenja će biti u tome što je u regresionoj analizi ispravno iscrtati zavisnu varijablu – u našem slučaju, “SPS podršku” na Y-osi, dok u korelacionoj analizi to nije bitno. Nakon čišćenja odstupanja, dijagram raspršenosti izgleda ovako:

Osnovna ideja regresijske analize je da je, imajući opći trend za varijable - u obliku regresijske linije - moguće predvidjeti vrijednost zavisne varijable, s obzirom na vrijednosti nezavisne.

Zamislimo uobičajenu matematiku linearna funkcija. Svaka prava linija u Euklidskom prostoru može se opisati formulom:

gdje je a konstanta koja specificira pomak duž ordinatne ose; b je koeficijent koji određuje ugao nagiba linije.

Poznavajući nagib i konstantu, možete izračunati (predvidjeti) vrijednost y za bilo koji x.

Ova najjednostavnija funkcija činila je osnovu modela regresione analize uz upozorenje da nećemo tačno predviđati vrijednost y, već unutar određenog intervala povjerenja, tj. otprilike.

Konstanta je tačka preseka linije regresije i y-ose (F-presek, koji se obično označava kao „presretač” u statističkim paketima). U našem primjeru sa glasanjem za Savez desnih snaga, njegova zaokružena vrijednost će biti 10,55. Ugaoni koeficijent b će biti približno -0,1 (kao u korelacionoj analizi, znak pokazuje vrstu veze - direktnu ili inverznu). Tako će rezultujući model imati oblik SP C = -0,1 x Sel. nas. + 10.55.

Dakle, za slučaj „Republike Adigeje“ sa udelom ruralnog stanovništva od 47%, predviđena vrednost će biti 5,63:

ATP = -0,10 x 47 + 10,55 = 5,63.

Razlika između originalne i predviđene vrijednosti naziva se ostatak (s tim pojmom, koji je fundamentalan za statistiku, već smo se susreli pri analizi kontingentnih tablica). Dakle, za slučaj "Republike Adigeje" ostatak će biti jednak 3,92 - 5,63 = -1,71. Što je veća modularna vrijednost ostatka, to je manje uspješno predviđena vrijednost.

Izračunavamo predviđene vrijednosti i ostatke za sve slučajeve:

|

Analiza omjera početnih i predviđenih vrijednosti služi za procjenu kvaliteta rezultirajućeg modela i njegove prediktivne sposobnosti. Jedan od glavnih pokazatelja statistike regresije je koeficijent višestruke korelacije R - koeficijent korelacije između originalne i predviđene vrijednosti zavisne varijable. U parnoj regresionoj analizi jednak je uobičajenom Pirsonovom koeficijentu korelacije između zavisnih i nezavisnih varijabli, u našem slučaju - 0,63. Za smisleno tumačenje višestrukog R, mora se pretvoriti u koeficijent determinacije. To se radi na isti način kao u korelacionoj analizi - kvadriranjem. Koeficijent determinacije R-kvadrat (R 2) pokazuje proporciju varijacije zavisne varijable koja je objašnjena nezavisnom varijablom(ama).

U našem slučaju, R 2 = 0,39 (0,63 2); to znači da varijabla „udio ruralnog stanovništva“ objašnjava otprilike 40% varijacije u varijabli „SPS podrška“. Što je veći koeficijent determinacije, to je veći kvalitet modela.

Drugi pokazatelj kvaliteta modela je standardna greška procjene. Ovo je mjera koliko su tačke „rasute“ oko regresijske linije. Mjera širenja za intervalne varijable je standardna devijacija. Prema tome, standardna greška procjene je standardna devijacija distribucije reziduala. Što je veća njegova vrijednost, veći je raspršivanje i lošiji je model. U našem slučaju, standardna greška je 2,18. Upravo za taj iznos će naš model „prosečno grešiti” prilikom predviđanja vrednosti varijable „SPS podrška”.

Regresijska statistika također uključuje analizu varijanse. Uz njegovu pomoć saznajemo: 1) koliki je udio varijacije (disperzije) zavisne varijable objašnjen nezavisnom varijablom; 2) koliki deo varijanse zavisne varijable čine ostaci (neobjašnjivi deo); 3) koliki je omjer ove dvije veličine (/"-odnos). Statistika disperzije je posebno važna za studije uzorka - pokazuje koliko je vjerovatno da postoji veza između nezavisnih i zavisnih varijabli u populaciji. Međutim, za kontinuiranim studijama (kao u našem primjeru) rezultati analize varijanse nisu korisni. U ovom slučaju provjeravaju da li je identificirani statistički obrazac uzrokovan slučajnošću slučajnih okolnosti, u kojoj mjeri je karakterističan za skup uslova. u kojoj se nalazi ispitana populacija, odnosno utvrđeno je da dobijeni rezultat nije tačan za neki širi opšti agregat, već stepen njegove pravilnosti, oslobođenosti od slučajnih uticaja.

U našem slučaju, ANOVA statistika je sljedeća:

| SS | df | MS | F | značenje | |

| Regres. | 258,77 | 1,00 | 258,77 | 54,29 | 0.000000001 |

| Ostatak | 395,59 | 83,00 | L,11 | ||

| Ukupno | 654,36 |

F-razmjer od 54,29 je značajan na nivou od 0,0000000001. Shodno tome, sa sigurnošću možemo odbaciti nultu hipotezu (da je odnos koji smo otkrili rezultat slučajnosti).

Kriterijum t ima sličnu funkciju, ali u odnosu na koeficijente regresije (ugaoni i F-presek). Koristeći / kriterij testiramo hipotezu da su u općoj populaciji koeficijenti regresije jednaki nuli. U našem slučaju, opet možemo sa sigurnošću odbaciti nultu hipotezu.

Višestruka regresijska analiza

Model višestruke regresije je skoro identičan modelu uparene regresije; jedina razlika je u tome što je nekoliko nezavisnih varijabli sekvencijalno uključeno u linearnu funkciju:

Y = b1X1 + b2X2 + …+ bpXp + a.

Ako postoji više od dvije nezavisne varijable, ne možemo dobiti vizualnu predstavu o njihovom odnosu u tom pogledu, višestruka regresija je manje „vizualna“ od regresije u paru. Kada imate dvije nezavisne varijable, može biti korisno prikazati podatke u 3D dijagramu raspršenja. U profesionalnim statističkim softverskim paketima (na primjer, Statistica) postoji mogućnost rotiranja trodimenzionalnog grafikona, što vam omogućava da vizualno dobro predstavite strukturu podataka.

Kod rada sa višestrukom regresijom, za razliku od parne regresije, potrebno je odrediti algoritam analize. Standardni algoritam uključuje sve dostupne prediktore u konačnom regresijskom modelu. Algoritam korak po korak uključuje sekvencijalno uključivanje (isključivanje) nezavisnih varijabli na osnovu njihove objašnjavajuće „težine“. Stepwise metoda je dobra kada postoji mnogo nezavisnih varijabli; “čisti” model od iskreno slabih prediktora, čineći ga kompaktnijim i konciznijim.

Dodatni uslov za ispravnost višestruke regresije (uz interval, normalnost i linearnost) je odsustvo multikolinearnosti – prisustvo jakih korelacija između nezavisnih varijabli.

Interpretacija statistike višestruke regresije uključuje sve elemente koje smo razmotrili za slučaj parne regresije. Pored toga, postoje i druge važne komponente statistike višestruke regresione analize.

Rad ćemo ilustrovati višestrukom regresijom na primjeru testiranja hipoteza koje objašnjavaju razlike u nivou izborne aktivnosti u ruskim regijama. Specifične empirijske studije sugeriraju da na nivo izlaznosti birača utiču:

Nacionalni faktor (varijabla “Rusko stanovništvo”; operacionalizovano kao udio ruskog stanovništva u konstitutivnim entitetima Ruske Federacije). Pretpostavlja se da povećanje udjela ruskog stanovništva dovodi do smanjenja izlaznosti birača;

Faktor urbanizacije (varijabilna " gradsko stanovništvo"; operacionalizovan kao udeo gradskog stanovništva u konstitutivnim entitetima Ruske Federacije, već smo radili sa ovim faktorom u okviru korelacione analize); Pretpostavlja se da povećanje udjela gradskog stanovništva dovodi i do smanjenja izlaznosti birača.

Zavisna varijabla - "intenzitet izborne aktivnosti" ("aktivan") operacionalizovana je kroz podatke o prosječnom odzivu po regionima na saveznim izborima od 1995. do 2003. godine. Početna tabela podataka za dvije nezavisne i jednu zavisnu varijablu bit će sljedeća:

| Dešava se | Varijable | ||

| Imovina. | Gor. nas. | Rus. nas. | |

| Republika Adygea | 64,92 | 53 | 68 |

| Republika Altai | 68,60 | 24 | 60 |

| Republika Burjatija | 60,75 | 59 | 70 |

| Republika Dagestan | 79,92 | 41 | 9 |

| Republika Ingušetija | 75,05 | 41 | 23 |

| Republika Kalmikija | 68,52 | 39 | 37 |

| Republika Karachay-Cherkess | 66,68 | 44 | 42 |

| Republika Karelija | 61,70 | 73 | 73 |

| Republika Komi | 59,60 | 74 | 57 |

| Republika Mari El | 65,19 | 62 | 47 |

itd. (nakon čišćenja emisija ostaje 83 od 88 slučajeva)

Statistike koje opisuju kvalitet modela:

1. Višestruki R = 0,62; L-kvadrat = 0,38. Shodno tome, nacionalni faktor i faktor urbanizacije zajedno objašnjavaju oko 38% varijacije varijable „izborna aktivnost“.

2. Prosječna greška je 3,38. Upravo toliko je „prosječno pogrešan“ konstruirani model kada se predviđa nivo izlaznosti.

3. /l-odnos objašnjene i neobjašnjive varijacije je 25,2 na nivou 0,000000003. Odbacuje se nulta hipoteza o slučajnosti identifikovanih veza.

4. Kriterijum / za konstantne i regresijske koeficijente varijabli „gradsko stanovništvo“ i „rusko stanovništvo“ je značajan na nivou od 0,0000001; 0,00005 i 0,007 respektivno. Nul hipoteza da su koeficijenti slučajni se odbacuje.

Dodatne korisne statistike u analizi odnosa između originalne i predviđene vrijednosti zavisne varijable su Mahalanobisova udaljenost i Cookova udaljenost. Prvi je mjera jedinstvenosti slučaja (pokazuje koliko kombinacija vrijednosti svih nezavisnih varijabli za dati slučaj odstupa od prosječne vrijednosti za sve nezavisne varijable istovremeno). Druga je mjera uticaja slučaja. Različita opažanja imaju različite efekte na nagib linije regresije, a Cookova udaljenost se može koristiti za njihovo upoređivanje na ovom indikatoru. Ovo može biti korisno pri čišćenju izvanrednih vrijednosti (odvojeni slučaj se može smatrati pretjerano utjecajnim slučajem).

U našem primjeru, jedinstveni i utjecajni slučajevi uključuju Dagestan.

| Dešava se | Original vrijednosti | Predska vrijednosti | Ostaci | Udaljenost Mahalanobis | Udaljenost |

| Adygea | 64,92 | 66,33 | -1,40 | 0,69 | 0,00 |

| Republika Altai | 68,60 | 69.91 | -1,31 | 6,80 | 0,01 |

| Republika Burjatija | 60,75 | 65,56 | -4,81 | 0,23 | 0,01 |

| Republika Dagestan | 79,92 | 71,01 | 8,91 | 10,57 | 0,44 |

| Republika Ingušetija | 75,05 | 70,21 | 4,84 | 6,73 | 0,08 |

| Republika Kalmikija | 68,52 | 69,59 | -1,07 | 4,20 | 0,00 |

Sam regresijski model ima sljedeće parametre: Y-presjek (konstanta) = 75,99; b (horizontalno) = -0,1; Kommersant (rus. nas.) = -0,06. Konačna formula:

Aktivan, = -0,1 x Hor. us.n+- 0,06 x Rus. us.n + 75,99.

Možemo li uporediti „snagu objašnjenja“ prediktora na osnovu vrijednosti koeficijenta 61. U ovom slučaju, da, pošto obje nezavisne varijable imaju isti format procenta. Međutim, najčešće se višestruka regresija bavi varijablama mjerenim na različitim skalama (na primjer, nivo prihoda u rubljama i starost u godinama). Stoga, u opštem slučaju, nije ispravno porediti prediktivne sposobnosti varijabli koristeći koeficijent regresije. U statistici višestruke regresije postoji poseban beta koeficijent (B) za ovu svrhu, koji se posebno izračunava za svaku nezavisnu varijablu. Predstavlja parcijalni (izračunat nakon uzimanja u obzir uticaja svih ostalih prediktora) koeficijent korelacije između faktora i odgovora i pokazuje nezavisni doprinos faktora predviđanju vrednosti odgovora. U parnoj regresionoj analizi, beta koeficijent je razumljivo jednak koeficijentu parne korelacije između zavisne i nezavisne varijable.

U našem primjeru, beta (Highland populacija) = -0,43, beta (Rusko stanovništvo) = -0,28. Dakle, oba faktora negativno utiču na nivo izborne aktivnosti, dok je značaj faktora urbanizacije znatno veći od značaja nacionalnog faktora. Kombinovani uticaj oba faktora određuje oko 38% varijacije varijable „izborna aktivnost” (vidi vrednost L-kvadrata).

1. Termin „regresija“ prvi je uveo osnivač biometrije F. Galton (19. vek), čije je ideje razvio njegov sledbenik K. Pirson.

Regresiona analiza - metoda statističke obrade podataka koja vam omogućava mjerenje odnosa između jednog ili više uzroka (faktorske karakteristike) i posljedice (rezultativna karakteristika).

Potpiši- ovo je glavni razlikovna karakteristika, karakteristika fenomena ili procesa koji se proučava.

Efikasan znak - indikator koji se proučava.

Faktorski znak- indikator koji utiče na vrijednost rezultirajuće karakteristike.

Svrha regresione analize je da se proceni funkcionalna zavisnost prosečne vrednosti rezultujuće karakteristike ( at) od faktora ( x 1, x 2, …, x n), izraženo kao regresijske jednačine

at= f(x 1, x 2, …, x n). (6.1)

Postoje dvije vrste regresije: uparene i višestruke.

Uparena (jednostavna) regresija- jednačina oblika:

at= f(x). (6.2)

Rezultirajuća karakteristika u regresiji para se smatra funkcijom jednog argumenta, tj. jedna faktorska karakteristika.

Regresiona analiza uključuje sljedeće korake:

· određivanje tipa funkcije;

· određivanje koeficijenata regresije;

· izračunavanje teoretskih vrijednosti rezultirajuće karakteristike;

· provjera statističke značajnosti koeficijenata regresije;

· provjera statističke značajnosti jednačine regresije.

Višestruka regresija- jednačina oblika:

at= f(x 1, x 2, …, x n). (6.3)

Rezultirajući atribut se smatra funkcijom nekoliko argumenata, tj. mnogo faktorskih znakova.

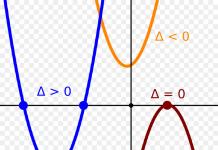

2. Da bi se pravilno odredio tip funkcije, potrebno je na osnovu teoretskih podataka pronaći smjer veze.

Prema smjeru povezivanja, regresija se dijeli na:

· direktna regresija nastaje pod uslovom da sa povećanjem ili smanjenjem nezavisne količine " X" vrijednosti zavisne veličine" y" također povećati ili smanjiti u skladu s tim;

· obrnuta regresija koje nastaju pod uslovom da sa povećanjem ili smanjenjem nezavisne vrednosti "X" zavisna količina" y" shodno tome smanjuje ili povećava.

Za karakterizaciju veza koriste se sljedeće vrste uparenih regresionih jednačina:

· y=a+bx– linearno;

· y=e ax + b – eksponencijalna;

· y=a+b/x – hiperbolično;

· y=a+b 1 x+b 2 x 2 – parabolično;

· y=ab x – eksponencijalno itd.

Gdje a, b 1, b 2- koeficijenti (parametri) jednačine; at- efektni znak; X- faktor faktor.

3. Konstrukcija regresione jednadžbe svodi se na procjenu njenih koeficijenata (parametara), za to koristimo metoda najmanjih kvadrata(MNC).

Metoda najmanjih kvadrata omogućava da se dobiju takve procjene parametara za koje je zbroj kvadrata odstupanja stvarnih vrijednosti rezultirajućeg atributa " at"od teoretskog" y x» minimalno, tj

Parametri regresijske jednadžbe y=a+bh primjenom metode najmanjih kvadrata procjenjuju se pomoću formula:

Gdje A - slobodni koeficijent, b- koeficijent regresije, pokazuje koliko će se rezultantni predznak promijeniti “ y"kada se promijeni karakteristika faktora" x» po jedinici mjere.

4. Za procjenu statističke značajnosti koeficijenata regresije koristi se Studentov t-test.

Šema za testiranje značajnosti koeficijenata regresije:

1) H 0: a=0, b=0 - koeficijenti regresije se ne razlikuju značajno od nule.

H 1: a≠ 0, b≠ 0 - koeficijenti regresije se značajno razlikuju od nule.

2) r=0,05 – nivo značajnosti.

Gdje m b,m a- slučajne greške:

;

;  . (6.7)

. (6.7)

4) t table(p; f),

Gdje f=n-k- 1 - broj stepeni slobode (tabelarna vrijednost), n- broj zapažanja, k X".

5) Ako , onda se odbija, tj. koeficijent je značajan.

Ako , onda je prihvaćeno, tj. koeficijent je beznačajan.

5. Za provjeru ispravnosti konstruirane regresione jednačine koristi se Fisherov kriterij.

Šema za testiranje značaja jednačine regresije:

1) H 0: Jednačina regresije nije značajna.

H 1: Jednačina regresije je značajna.

2) r=0,05 – nivo značajnosti.

3)  , (6.8)

, (6.8)

gdje je broj zapažanja; k- broj parametara u jednadžbi sa varijablama " X"; at- stvarna vrijednost rezultirajućeg atributa; y x- teorijsku vrijednost rezultantni znak; - koeficijent korelacije para.

4) F stol(p; f 1 ; f 2),

Gdje f 1 =k, f 2 =n-k-1- broj stupnjeva slobode (tabelarne vrijednosti).

5) Ako F izračunato >F tabela, tada je jednadžba regresije ispravno odabrana i može se koristiti u praksi.

Ako F calc

6. Glavni indikator koji odražava kvalitet regresione analize je koeficijent determinacije (R 2).

Koeficijent determinacije pokazuje koliki je udio zavisne varijable " at" uzima se u obzir u analizi i uzrokovan je uticajem na njega faktora uključenih u analizu.

Koeficijent determinacije (R 2) uzima vrijednosti u intervalu . Jednačina regresije je kvalitativna ako R 2 ≥0,8.

Koeficijent determinacije jednak je kvadratu koeficijenta korelacije, tj.

Primjer 6.1. Koristeći sljedeće podatke, konstruirajte i analizirajte jednadžbu regresije:

Rješenje.

1) Izračunajte koeficijent korelacije: . Odnos između znakova je direktan i umjeren.

2) Konstruirajte uparenu jednačinu linearne regresije.

2.1) Kreirajte proračunsku tabelu.

| № | X | at | Hu | x 2 | y x | (y-y x) 2 | ||

| 55,89 | 47,54 | 65,70 | ||||||

| 45,07 | 15,42 | 222,83 | ||||||

| 54,85 | 34,19 | 8,11 | ||||||

| 51,36 | 5,55 | 11,27 | ||||||

| 42,28 | 45,16 | 13,84 | ||||||

| 47,69 | 1,71 | 44,77 | ||||||

| 45,86 | 9,87 | 192,05 | ||||||

| Sum | 159,45 | 558,55 | ||||||

| Prosjek | 77519,6 | 22,78 | 79,79 | 2990,6 |

![]() ,

,

Uparena jednadžba linearne regresije: y x =25,17+0,087x.

3) Pronađite teorijske vrijednosti " y x"zamjenom stvarnih vrijednosti u jednadžbu regresije" X».

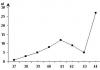

4) Napravite grafikone stvarnih " y" i teorijske vrijednosti" y x"efikasna karakteristika (slika 6.1):r xy =0,47) i mali broj zapažanja.

7) Izračunajte koeficijent determinacije: R 2=(0,47) 2 =0,22. Konstruisana jednačina je lošeg kvaliteta.

Jer proračuni pri izvođenju regresijske analize su prilično opsežni, preporučljivo je koristiti posebne programe (Statistica 10, SPSS, itd.).

Na slici 6.2 prikazana je tabela sa rezultatima regresione analize izvršene pomoću programa Statistica 10.

Slika 6.2. Rezultati regresione analize rađene pomoću programa Statistica 10

5. Literatura:

1. Gmurman V.E. Teorija vjerovatnoće i matematička statistika: Udžbenik. priručnik za univerzitete / V.E. Gmurman. - M.: Viša škola, 2003. - 479 str.

2. Koychubekov B.K. Biostatistika: Udžbenik. - Almati: Evero, 2014. - 154 str.

3. Lobotskaya N.L. Viša matematika. / N.L. Lobotskaya, Yu.V. Morozov, A.A. Dunaev. - Mn.: Viša škola, 1987. - 319 str.

4. Medić V.A., Tokmačev M.S., Fishman B.B. Statistika u medicini i biologiji: Vodič. U 2 toma / Ed. Yu.M. Komarova. T. 1. Teorijska statistika. - M.: Medicina, 2000. - 412 str.

5. Primjena metoda statističke analize za proučavanje javnog zdravlja i zdravstvene zaštite: udžbenik / ur. Kucherenko V.Z. - 4. izd., revidirano. i dodatne – M.: GEOTAR - Mediji, 2011. - 256 str.

U statističkom modeliranju, regresiona analiza je studija koja se koristi za procjenu odnosa između varijabli. Ova matematička metoda uključuje mnoge druge tehnike za modeliranje i analizu više varijabli gdje je fokus na odnosu između zavisne varijable i jedne ili više nezavisnih. Preciznije, regresiona analiza pomaže nam da shvatimo kako se tipična vrijednost zavisne varijable mijenja ako se jedna od nezavisnih varijabli promijeni dok druge nezavisne varijable ostaju fiksne.

U svim slučajevima, ciljna procjena je funkcija nezavisnih varijabli i naziva se regresijska funkcija. U regresijskoj analizi, također je od interesa karakterizirati promjenu zavisne varijable kao funkciju regresije, koja se može opisati korištenjem distribucije vjerovatnoće.

Problemi regresijske analize

Ova metoda statističkog istraživanja ima široku primenu za predviđanje, pri čemu njena upotreba ima značajnu prednost, ali ponekad može dovesti do iluzije ili lažnih odnosa, pa se preporučuje da se pažljivo koristi u navedenoj stvari, jer npr. korelacija ne znači uzročnost.

Za regresijsku analizu razvijen je veliki broj metoda, kao što su linearna i obična regresija najmanjih kvadrata, koje su parametarske. Njihova suština je da je funkcija regresije definirana u terminima konačnog broja nepoznatih parametara koji se procjenjuju iz podataka. Neparametrijska regresija omogućava da njena funkcija leži unutar određenog skupa funkcija, koje mogu biti beskonačno dimenzionalne.

Kao statistička metoda istraživanja, regresiona analiza u praksi zavisi od oblika procesa generisanja podataka i od toga kako se on odnosi na regresijski pristup. Budući da je pravi oblik generisanja procesa podataka obično nepoznat broj, regresiona analiza podataka često zavisi u određenoj mjeri od pretpostavki o procesu. Ove pretpostavke se ponekad mogu provjeriti ako ima dovoljno podataka. Regresijski modeli su često korisni čak i kada su pretpostavke umjereno narušene, iako možda neće raditi na vrhunskoj efikasnosti.

U užem smislu, regresija se može odnositi posebno na procjenu varijabli kontinuiranog odgovora, za razliku od diskretnih varijabli odgovora koje se koriste u klasifikaciji. Slučaj kontinuirane izlazne varijable se također naziva metrička regresija kako bi se razlikovao od povezanih problema.

Priča

Najraniji oblik regresije je dobro poznata metoda najmanjih kvadrata. Objavili su ga Legendre 1805. i Gauss 1809. Legendre i Gauss su primijenili metodu na problem određivanja orbita tijela oko Sunca (uglavnom kometa, ali kasnije i novootkrivenih sporednih planeta) iz astronomskih posmatranja. Gauss je 1821. objavio daljnji razvoj teorije najmanjih kvadrata, uključujući verziju Gauss-Markovljeve teoreme.

Termin "regresija" skovao je Francis Galton u 19. vijeku da opiše biološki fenomen. Ideja je bila da visina potomaka u odnosu na visinu njihovih predaka ima tendenciju regresije prema dolje prema normalnoj sredini. Za Galtona je regresija imala samo ovo biološko značenje, ali su kasnije njegov rad nastavili Udney Yoley i Karl Pearson i doveli ga u opštiji statistički kontekst. U radu Yulea i Pearsona, zajednička distribucija odgovora i eksplanatornih varijabli pretpostavlja se da je Gausova. Ovu pretpostavku je Fischer odbacio u radovima iz 1922. i 1925. godine. Fisher je sugerirao da je uvjetna distribucija varijable odgovora Gaussova, ali zajednička distribucija ne mora biti. U tom pogledu, Fišerov predlog je bliži Gaussovoj formulaciji iz 1821. Prije 1970. ponekad je trebalo i do 24 sata da se dobije rezultat regresione analize.

Metode regresijske analize i dalje su područje aktivnog istraživanja. Poslednjih decenija razvijene su nove metode za robusnu regresiju; regresije koje uključuju korelirane odgovore; metode regresije koje prihvataju različite vrste podataka koji nedostaju; neparametrijska regresija; Bayesove metode regresije; regresije u kojima se prediktorske varijable mjere sa greškom; regresija s više prediktora nego zapažanja i uzročno-posljedično zaključivanje s regresijom.

Regresijski modeli

Modeli regresijske analize uključuju sljedeće varijable:

- Nepoznati parametri, označeni kao beta, koji mogu biti skalar ili vektor.

- Nezavisne varijable, X.

- Zavisne varijable, Y.

Različite oblasti nauke u kojima se koristi regresiona analiza koriste različite termine umesto zavisnih i nezavisnih varijabli, ali u svim slučajevima regresioni model povezuje Y sa funkcijom X i β.

Aproksimacija se obično piše kao E(Y | X) = F(X, β). Da bi se izvršila regresijska analiza, mora se odrediti tip funkcije f. Manje uobičajeno, zasniva se na znanju o odnosu između Y i X, koje se ne oslanja na podatke. Ako takvo znanje nije dostupno, tada se bira fleksibilan ili pogodan oblik F.

Zavisna varijabla Y

Pretpostavimo sada da vektor nepoznatih parametara β ima dužinu k. Da bi izvršio regresijsku analizu, korisnik mora dati informacije o zavisnoj varijabli Y:

- Ako se posmatra N tačaka podataka oblika (Y, X), gdje je N< k, большинство классических подходов к регрессионному анализу не могут быть выполнены, так как система уравнений, определяющих модель регрессии в качестве недоопределенной, не имеет достаточного количества данных, чтобы восстановить β.

- Ako se posmatra tačno N = K i funkcija F je linearna, onda se jednačina Y = F(X, β) može rešiti tačno, a ne približno. Ovo se svodi na rješavanje skupa N-jednačina sa N-nepoznatima (elementi β) koji imaju jedinstveno rješenje sve dok je X linearno nezavisan. Ako je F nelinearan, možda neće biti rješenja ili može postojati mnogo rješenja.

- Najčešća situacija je kada se posmatra N > tačaka podataka. U ovom slučaju, u podacima ima dovoljno informacija za procjenu jedinstvene vrijednosti za β, koja na najbolji mogući način odgovara podacima, a regresijski model kada se primeni na podatke može se posmatrati kao preodređeni sistem u β.

U potonjem slučaju, regresiona analiza pruža alate za:

- Pronalaženje rješenja za nepoznate parametre β, koje će, na primjer, minimizirati udaljenost između izmjerene i predviđene vrijednosti Y.

- Pod određenim statističkim pretpostavkama, regresiona analiza koristi višak informacija za pružanje statističkih informacija o nepoznatim parametrima β i predviđenim vrijednostima zavisne varijable Y.

Potreban broj nezavisnih mjerenja

Razmotrimo regresijski model koji ima tri nepoznata parametra: β 0 , β 1 i β 2 . Pretpostavimo da eksperimentator izvrši 10 merenja na istoj vrednosti vektora nezavisne varijable X. U ovom slučaju, regresiona analiza ne proizvodi jedinstven skup vrednosti. Najbolje što možete učiniti je procijeniti srednju vrijednost i standardnu devijaciju zavisne varijable Y. Slično, mjerenjem dvije različite vrijednosti X, možete dobiti dovoljno podataka za regresiju s dvije nepoznate, ali ne i s tri ili više nepoznatih.

Ako su mjerenja eksperimentatora izvršena na tri različite vrijednosti vektora nezavisne varijable X, tada će regresiona analiza pružiti jedinstveni skup procjena za tri nepoznata parametra u β.

U slučaju opšte linearne regresije, gornja izjava je ekvivalentna zahtjevu da je matrica X T X inverzibilna.

Statističke pretpostavke

Kada je broj mjerenja N veći od broja nepoznatih parametara k i mjernih grešaka ε i , tada se, po pravilu, višak informacija sadržanih u mjerenjima tada širi i koristi za statistička predviđanja u vezi sa nepoznatim parametrima. Ovaj višak informacija naziva se stepen slobode regresije.

Fundamentalne pretpostavke

Klasične pretpostavke za regresijsku analizu uključuju:

- Uzorkovanje je reprezentativno za predviđanje inferencije.

- Termin greške je slučajna varijabla sa srednjom vrijednosti nula, koja je uslovljena varijablama koje objašnjavaju.

- Nezavisne varijable se mjere bez grešaka.

- Kao nezavisne varijable (prediktori), one su linearno nezavisne, odnosno nije moguće izraziti nijedan prediktor kao linearnu kombinaciju ostalih.

- Greške su nekorelirane, odnosno matrica kovarijanse greške dijagonala i svaki element koji nije nula je varijansa greške.

- Varijanca greške je konstantna kroz posmatranja (homoskedastičnost). Ako ne, onda se mogu koristiti ponderisani najmanji kvadrati ili druge metode.

Ove dovoljne uslove za procjenu najmanjih kvadrata poseduju potrebna svojstva, posebno ove pretpostavke znače da će procene parametara biti objektivne, konzistentne i efikasne, posebno kada se uzmu u obzir u klasi linearnih estimatora. Važno je napomenuti da dokazi rijetko ispunjavaju uslove. Odnosno, metoda se koristi čak i ako pretpostavke nisu tačne. Varijacije od pretpostavki se ponekad mogu koristiti kao mjera koliko je model koristan. Mnoge od ovih pretpostavki mogu se ublažiti naprednijim metodama. Izvještaji o statističkoj analizi obično uključuju analizu testova na uzorku podataka i metodologiju za korisnost modela.

Osim toga, varijable se u nekim slučajevima odnose na vrijednosti izmjerene na lokacijama. Mogu postojati prostorni trendovi i prostorne autokorelacije u varijablama koje krše statističke pretpostavke. Geografska ponderisana regresija je jedina metoda koja se bavi takvim podacima.

Karakteristika linearne regresije je da je zavisna varijabla, koja je Yi, linearna kombinacija parametara. Na primjer, jednostavna linearna regresija koristi jednu nezavisnu varijablu, x i , i dva parametra, β 0 i β 1 , za modeliranje n tačaka.

U višestrukoj linearnoj regresiji postoji više nezavisnih varijabli ili njihovih funkcija.

Kada se iz populacije uzme slučajni uzorak, njegovi parametri omogućavaju da se dobije model linearne regresije uzorka.

U ovom aspektu, najpopularnija je metoda najmanjih kvadrata. Koristi se za dobivanje procjena parametara koje minimiziraju sumu kvadrata reziduala. Ova vrsta minimizacije (koja je tipična za linearnu regresiju) ove funkcije dovodi do skupa normalne jednačine i zapošljavanje linearne jednačine sa parametrima koji se rješavaju kako bi se dobile procjene parametara.

Pod daljom pretpostavkom da se greška populacije generalno širi, istraživač može koristiti ove standardne procjene greške da kreira intervale povjerenja i provodi testove hipoteza o njenim parametrima.

Nelinearna regresijska analiza

Primjer u kojem funkcija nije linearna u odnosu na parametre ukazuje na to da zbir kvadrata treba minimizirati korištenjem iterativne procedure. Ovo uvodi mnoge komplikacije koje definiraju razlike između linearnih i nelinearnih metoda najmanjih kvadrata. Posljedično, rezultati regresione analize pri korištenju nelinearna metoda ponekad nepredvidivo.

Proračun snage i veličine uzorka

Generalno, ne postoje konzistentne metode u odnosu na broj posmatranja u odnosu na broj nezavisnih varijabli u modelu. Prvo pravilo su predložili Dobra i Hardin i izgleda kao N = t^n, gdje je N veličina uzorka, n broj nezavisnih varijabli, a t broj opservacija potrebnih za postizanje željene tačnosti ako bi model imao samo jedna nezavisna varijabla. Na primjer, istraživač gradi model linearne regresije koristeći skup podataka koji sadrži 1000 pacijenata (N). Ako istraživač odluči da je potrebno pet opservacija za precizno definiranje linije (m), tada je maksimalni broj nezavisnih varijabli koje model može podržati je 4.

Druge metode

Iako se parametri regresijskog modela obično procjenjuju korištenjem metode najmanjih kvadrata, postoje i druge metode koje se koriste mnogo rjeđe. Na primjer, ovo su sljedeće metode:

- Bayesove metode (na primjer, Bayesova linearna regresija).

- Procentualna regresija, koja se koristi za situacije u kojima se smanjenje procentualnih grešaka smatra prikladnijim.

- Najmanja apsolutna odstupanja, koja su robusnija u prisustvu odstupanja koja dovode do kvantilne regresije.

- Neparametrijska regresija, koja zahtijeva veliki broj opservacija i proračuna.

- Metrika učenja na daljinu koja se uči da pronađe smislenu metriku udaljenosti u datom ulaznom prostoru.

Softver

Svi glavni statistički softverski paketi izvode analizu regresije najmanjih kvadrata. Jednostavna linearna regresija i analiza višestruke regresije mogu se koristiti u nekim aplikacijama za tabelarne proračune, kao iu nekim kalkulatorima. Iako mnogi statistički softverski paketi mogu izvesti različite vrste neparametarske i robusne regresije, ove metode su manje standardizirane; različiti softverski paketi implementiraju različite metode. Specijalizovana regresija softver je razvijen za upotrebu u oblastima kao što su analiza pregleda i neuroimaging.

Koncept regresije. Zavisnost između varijabli x I y mogu se opisati na različite načine. Konkretno, bilo koji oblik veze može se izraziti opštom jednačinom, gdje y tretira se kao zavisna varijabla, ili funkcije od druge - nezavisne varijable x, tzv argument. Korespondencija između argumenta i funkcije može se odrediti pomoću tabele, formule, grafikona, itd. Poziva se promjena funkcije ovisno o promjeni jednog ili više argumenata regresija. Sva sredstva koja se koriste za opisivanje korelacija čine sadržaj regresiona analiza.

Za izražavanje regresije, korelacionih jednačina ili jednačina regresije koriste se empirijski i teorijski izračunati regresijski nizovi, njihovi grafovi, nazvani regresijskim linijama, kao i koeficijenti linearne i nelinearne regresije.

Regresijski indikatori izražavaju korelacijski odnos bilateralno, uzimajući u obzir promjene u prosječnim vrijednostima karakteristike Y pri promeni vrednosti x i sign X, i, obrnuto, pokazuju promjenu prosječnih vrijednosti karakteristike X prema promijenjenim vrijednostima y i sign Y. Izuzetak su vremenske serije, ili vremenske serije, koje pokazuju promjene karakteristika tokom vremena. Regresija takvih serija je jednostrana.

Postoji mnogo različitih oblika i vrsta korelacija. Zadatak se svodi na identifikaciju oblika veze u svakom konkretnom slučaju i izražavanje odgovarajućom korelacionom jednadžbom, koja nam omogućava da predvidimo moguće promjene u jednoj karakteristici. Y na osnovu poznatih promjena u drugom X, vezano za prvi korelacijski.

12.1 Linearna regresija

Jednačina regresije. Rezultati opservacija izvršenih na određenom biološkom objektu na osnovu koreliranih karakteristika x I y, može biti predstavljen tačkama na ravni konstruisanjem sistema pravougaone koordinate. Rezultat je neka vrsta dijagrama raspršenosti koji omogućava prosuđivanje oblika i bliskosti odnosa između različitih karakteristika. Vrlo često ovaj odnos izgleda kao prava linija ili se može aproksimirati pravom linijom.

Linearni odnos između varijabli x I y je opisan općom jednačinom, gdje je a, b, c, d,... – parametri jednadžbe koji određuju odnose između argumenata x 1 , x 2 , x 3 , …, x m i funkcije.

U praksi se ne uzimaju u obzir svi mogući argumenti, već samo neki argumenti, u najjednostavnijem slučaju, samo jedan:

U jednadžbi linearne regresije (1) a je slobodni termin i parametar b određuje nagib linije regresije u odnosu na pravougaone koordinatne ose. U analitičkoj geometriji ovaj parametar se naziva nagib, au biometriji – koeficijent regresije. Vizuelni prikaz ovog parametra i položaja linija regresije Y By X I X By Y u pravougaonom koordinatnom sistemu daje sl. 1.

Rice. 1 Regresijske linije od Y prema X i X prema Y u sistemu

pravougaone koordinate

Regresijske linije, kao što je prikazano na slici 1, sijeku se u tački O (,), što odgovara srednjim aritmetičkim vrijednostima karakteristika koje su međusobno povezane Y I X. Prilikom konstruiranja regresijskih grafika, vrijednosti nezavisne varijable X se crtaju duž apscisne ose, a vrijednosti zavisne varijable, odnosno funkcije Y, crtaju se duž ordinatne ose AB koja prolazi kroz tačku O (, ) odgovara potpunoj (funkcionalnoj) vezi između varijabli Y I X, kada je koeficijent korelacije . Što je jača veza između Y I X, što su linije regresije bliže AB, i obrnuto, što su bliže slabija veza između ovih vrijednosti, regresijske linije su udaljenije od AB. Ako ne postoji veza između karakteristika, linije regresije su pod pravim uglom jedna u odnosu na drugu i .

Pošto regresijski indikatori izražavaju korelacioni odnos bilateralno, regresionu jednačinu (1) treba napisati na sledeći način:

Prva formula određuje prosječne vrijednosti kada se karakteristika promijeni X po jedinici mjere, za drugu - prosječne vrijednosti pri promjeni za jednu jedinicu mjere atributa Y.

Koeficijent regresije. Koeficijent regresije pokazuje koliko je u prosjeku vrijednost jedne karakteristike y mijenja se kada se mjera druge, u korelaciji sa, promijeni za jedan Y sign X. Ovaj indikator je određen formulom

Evo vrijednosti s pomnoženo veličinom intervala časova λ , ako su pronađeni iz varijacionih serija ili korelacionih tabela.

Koeficijent regresije se može izračunati bez izračunavanja standardnih devijacija s y I s x prema formuli

Ako je koeficijent korelacije nepoznat, koeficijent regresije se određuje na sljedeći način:

Odnos regresije i koeficijenata korelacije. Upoređujući formule (11.1) (tema 11) i (12.5), vidimo: njihov brojilac ima istu vrijednost, što ukazuje na povezanost ovih pokazatelja. Ovaj odnos se izražava jednakošću

Dakle, koeficijent korelacije jednak je geometrijskoj sredini koeficijenata b yx I b xy. Formula (6) dozvoljava, prvo, na osnovu poznatih vrijednosti koeficijenata regresije b yx I b xy odrediti koeficijent regresije R xy, i drugo, provjeriti ispravnost izračunavanja ovog pokazatelja korelacije R xy između različitih karakteristika X I Y.

Kao i koeficijent korelacije, koeficijent regresije karakteriše samo linearni odnos i prati ga znak plus za pozitivan odnos i znak minus za negativan odnos.

Određivanje parametara linearne regresije. Poznato je da je zbir kvadrata odstupanja varijanta x i od prosjeka je najmanja vrijednost, tj. Ova teorema čini osnovu metode najmanjih kvadrata. Što se tiče linearne regresije [vidi formula (1)] zahtjev ove teoreme je zadovoljen određenim sistemom jednačina tzv. normalno:

Zajedničko rješenje ovih jednačina s obzirom na parametre a I b dovodi do sljedećih rezultata:

![]() ;

;

![]() ;

;

![]() , odakle i.

, odakle i.

S obzirom na dvosmjernu prirodu odnosa između varijabli Y I X, formula za određivanje parametra A treba izraziti ovako:

![]() i . (7)

i . (7)

Parametar b, ili koeficijent regresije, određuje se sljedećim formulama:

Konstrukcija empirijskih regresijskih serija. Ovisno o dostupnosti veliki broj zapažanja, regresiona analiza počinje izgradnjom empirijskih regresijskih serija. Empirijski regresijski niz formira se izračunavanjem iz vrijednosti jedne promjenjive karakteristike X prosječne vrijednosti drugog, u korelaciji sa X sign Y. Drugim riječima, konstrukcija empirijskih regresijskih serija svodi se na pronalaženje grupnih prosjeka iz odgovarajućih vrijednosti karakteristika Y i X.

Empirijski regresijski niz je dvostruki niz brojeva koji se može predstaviti tačkama na ravni, a zatim se povezivanjem ovih tačaka pravim segmentima može dobiti empirijska regresijska linija. Empirijski regresijski nizovi, posebno njihovi grafovi, tzv regresijske linije, daju jasnu predstavu o obliku i bliskosti korelacije između različitih karakteristika.

Usklađivanje empirijskih regresijskih serija. Grafovi empirijskih regresijskih nizova se po pravilu ne kreću glatko, već isprekidane linije. Ovo se objašnjava činjenicom da, uz glavne razloge koji određuju opći obrazac varijabilnosti koreliranih karakteristika, na njihovu veličinu utječe i utjecaj brojnih sekundarnih razloga koji uzrokuju nasumične fluktuacije u čvornim točkama regresije. Da bi se identifikovala glavna tendencija (trend) konjugirane varijacije koreliranih karakteristika, potrebno je zamijeniti isprekidane linije glatkim, glatko tekućim regresijskim linijama. Zove se proces zamjene isprekidanih linija glatkim usklađivanje empirijskih serija I regresijske linije.

Metoda grafičkog poravnanja. Ovo je najjednostavniji metod koji ne zahtijeva računski rad. Njegova suština se svodi na sljedeće. Empirijski regresijski niz je prikazan kao graf u pravougaonom koordinatnom sistemu. Zatim se vizualno ocrtavaju središnje točke regresije, duž kojih se crta puna linija pomoću ravnala ili uzorka. Nedostatak ove metode je očigledan: ne isključuje utjecaj individualnih osobina istraživača na rezultate poravnanja empirijskih regresijskih linija. Stoga, u slučajevima kada je potrebna veća tačnost pri zamjeni izlomljenih regresijskih linija glatkim, koriste se druge metode poravnanja empirijskih serija.

Metoda pokretnog prosjeka. Suština ove metode svodi se na sekvencijalno izračunavanje aritmetičkih prosjeka iz dva ili tri susjedna člana empirijskog niza. Ova metoda je posebno pogodna u slučajevima kada je empirijski niz predstavljen velikim brojem pojmova, tako da gubitak dva od njih - ekstremnih, koji je neizbježan kod ovog načina poravnanja, neće primjetno utjecati na njegovu strukturu.

Metoda najmanjih kvadrata. Ovu metodu je početkom 19. vijeka predložio A.M. Legendre i, nezavisno od njega, K. Gauss. Omogućava vam da najpreciznije uskladite empirijske serije. Ova metoda, kao što je gore prikazano, temelji se na pretpostavci da je zbir kvadrata odstupanja opcija x i od njihovog prosjeka postoji minimalna vrijednost, odnosno otuda naziv metode, koja se koristi ne samo u ekologiji, već iu tehnologiji. Metoda najmanjih kvadrata je objektivna i univerzalna, koristi se u velikom broju slučajeva pri pronalaženju empirijskih jednačina za regresijske serije i određivanju njihovih parametara.

Zahtjev metode najmanjih kvadrata je da se teorijske točke linije regresije moraju dobiti na takav način da se zbroj kvadrata odstupanja od ovih tačaka za empirijska opažanja y i bio minimalan, tj.

Izračunavanjem minimuma ovog izraza u skladu sa principima matematičke analize i njegovom transformacijom na određeni način, može se dobiti sistem tzv. normalne jednačine, u kojem su nepoznate vrijednosti traženi parametri regresijske jednadžbe, a poznati koeficijenti su određeni empirijskim vrijednostima karakteristika, obično sumama njihovih vrijednosti i njihovih unakrsnih proizvoda.

Višestruka linearna regresija. Odnos između nekoliko varijabli obično se izražava višestrukom regresijskom jednadžbom, što može biti linearno I nelinearni. U svom najjednostavnijem obliku, višestruka regresija se izražava kao jednačina s dvije nezavisne varijable ( x, z):

Gdje a– slobodni član jednačine; b I c– parametri jednačine. Za pronalaženje parametara jednačine (10) (pomoću metode najmanjih kvadrata) koristi se sljedeći sistem normalnih jednačina:

Dinamičke serije. Poravnanje redova. Promjene karakteristika tokom vremena formiraju tzv vremenske serije ili dinamicke serije. Karakteristična karakteristika takvih serija je da je nezavisna varijabla X ovdje uvijek faktor vremena, a zavisna varijabla Y je promjenjiva karakteristika. Ovisno o regresijskoj seriji, odnos između varijabli X i Y je jednostran, jer vremenski faktor ne zavisi od varijabilnosti karakteristika. Uprkos ovim karakteristikama, dinamičke serije se mogu uporediti sa regresijskim serijama i obraditi koristeći iste metode.

Kao i regresijski nizovi, empirijske serije dinamike imaju uticaj ne samo glavnih, već i brojnih sekundarnih (slučajnih) faktora koji prikrivaju glavni trend varijabilnosti karakteristika, koji se jezikom statistike naziva trend.

Analiza vremenskih serija počinje identifikovanjem oblika trenda. Da biste to učinili, vremenska serija je prikazana kao linijski graf u pravokutnom koordinatnom sistemu. U ovom slučaju, vremenske tačke (godine, mjeseci i druge jedinice vremena) su iscrtane duž apscisne ose, a vrijednosti zavisne varijable Y su prikazane duž ordinatne ose linearna zavisnost između varijabli X i Y (linearni trend), za poravnavanje dinamičkog niza korištenjem metode najmanjih kvadrata, najprikladnija je jednadžba regresije u obliku odstupanja članova niza zavisne varijable Y od aritmetičke sredine serije nezavisne varijable X:

Ovdje je parametar linearne regresije.

Numeričke karakteristike dinamičkih serija. Glavne generalizirajuće numeričke karakteristike dinamičkih serija uključuju geometrijska sredina i aritmetička sredina blizu njega. Oni karakterišu prosječnu stopu kojom se vrijednost zavisne varijable mijenja u određenim vremenskim periodima:

Procjena varijabilnosti članova dinamičke serije je standardna devijacija. Prilikom odabira jednadžbi regresije za opisivanje vremenskih serija uzima se u obzir oblik trenda, koji može biti linearan (ili svedeni na linearan) i nelinearan. Ispravnost izbora regresijske jednadžbe obično se ocjenjuje po sličnosti empirijski promatranih i izračunatih vrijednosti zavisne varijable. Tačnije rješenje ovog problema je regresiona analiza metode varijanse (tema 12, stav 4).

Korelacija vremenskih serija.Često je potrebno uporediti dinamiku paralelnih vremenskih serija koje su međusobno povezane određenim opštim uslovima, na primer, da bi se utvrdila veza između poljoprivredne proizvodnje i rasta stočnog fonda u određenom vremenskom periodu. U takvim slučajevima, karakteristika odnosa između varijabli X i Y je koeficijent korelacije R xy (u prisustvu linearnog trenda).

Poznato je da je trend vremenskih serija, po pravilu, zamagljen fluktuacijama u terminima niza zavisne varijable Y. To dovodi do dvostrukog problema: mjerenje zavisnosti između upoređenih serija, bez isključivanja trenda, i mjerenje zavisnosti između susjednih članova iste serije, isključujući trend. U prvom slučaju, indikator bliskosti veze između upoređenih vremenskih serija je koeficijent korelacije(ako je odnos linearan), u drugom – koeficijent autokorelacije. Ovi indikatori imaju različita značenja, iako se računaju pomoću istih formula (vidi temu 11).

Lako je vidjeti da na vrijednost koeficijenta autokorelacije utiče varijabilnost članova serije zavisne varijable: što članovi serije manje odstupaju od trenda, to je veći koeficijent autokorelacije i obrnuto.

Savremena politička nauka polazi sa pozicije povezanosti svih pojava i procesa u društvu. Nemoguće je razumjeti događaje i procese, prognozirati i upravljati pojavama političkog života bez proučavanja veza i zavisnosti koje postoje u političkoj sferi društva. Jedan od najčešćih zadataka u istraživanju politike je ispitivanje odnosa između nekih posmatranih varijabli. Čitava klasa tehnika statističke analize, objedinjene pod opštim nazivom „regresiona analiza“ (ili, kako se još naziva, „korelaciono-regresiona analiza“), pomaže u rešavanju ovog problema. Međutim, ako korelaciona analiza omogućava procjenu jačine veze između dvije varijable, onda je pomoću regresione analize moguće odrediti vrstu ovog odnosa i predvidjeti ovisnost vrijednosti varijable od vrijednosti druge varijable.

Prvo, sjetimo se šta je korelacija. Korelacija naziva najvažnijim poseban slučaj statistički odnos, koji se sastoji u tome da jednake vrijednosti jedne varijable odgovaraju različitim prosječne vrijednosti drugi. Sa promjenom vrijednosti atributa x, prirodno se mijenja prosječna vrijednost atributa y, dok se u svakom pojedinačnom slučaju vrijednost atributa at(sa različitim vjerovatnoćama) može poprimiti mnogo različitih vrijednosti.

Pojava pojma "korelacija" u statistici (a politička nauka uključuje dostignuća statistike za rješavanje njenih problema, što je stoga srodna disciplina s političkim naukama) povezuje se s imenom engleskog biologa i statističara Francisa Galtona, koji je predložio u 19. veku. teorijske osnove korelacione i regresijske analize. Termin "korelacija" bio je poznat u nauci ranije. Konkretno, u paleontologiji još u 18. vijeku. koristio ga je francuski naučnik Georges Cuvier. Uveo je takozvani zakon korelacije, uz pomoć kojeg je bilo moguće rekonstruisati njihov izgled iz ostataka životinja pronađenih tokom iskopavanja.

Poznata je priča povezana sa imenom ovog naučnika i njegovim zakonom korelacije. Tako su na fakultetskom raspustu studenti koji su odlučili da se izigraju sa poznatim profesorom navukli na jednog studenta kozju kožu sa rogovima i kopitima. Popeo se kroz prozor Cuvierove spavaće sobe i povikao: "Poješću te." Profesor se probudio, pogledao siluetu i odgovorio: „Ako imaš rogove i kopita, onda si biljožder i ne možeš me pojesti. A ako ne poznajete zakon korelacije, dobit ćete lošu ocjenu.” Okrenuo se na drugu stranu i zaspao. Šalim se, ali u ovom primjeru promatramo poseban slučaj korištenja višestruke korelaciono-regresijske analize. Ovdje je profesor, na osnovu poznavanja vrijednosti dvije uočene karakteristike (prisustvo rogova i kopita), na osnovu zakona korelacije, izveo prosječnu vrijednost treće karakteristike (klase kojoj ova životinja pripada - biljojedi ). U ovom slučaju ne govorimo o specifičnoj vrijednosti ove varijable (tj., data životinja bi mogla poprimiti različite vrijednosti na nominalnoj skali - to može biti koza, ovan ili bik...).

Pređimo sada na termin „regresija“. Strogo govoreći, to nije povezano sa značenjem onih statističkih problema koji se rješavaju ovom metodom. Objašnjenje pojma može se dati samo na osnovu poznavanja istorije razvoja metoda za proučavanje veza između karakteristika. Jedan od prvih primjera istraživanja ove vrste bio je rad statističara F. Galtona i K. Pearsona, koji su pokušali otkriti obrazac između visine očeva i njihove djece prema dvije uočljive karakteristike (gdje X- visina očeva i U- visina dece). U svojoj studiji potvrdili su početnu hipotezu da u prosjeku visoki očevi odgajaju visoku djecu. Isti princip se primjenjuje na niže očeve i djecu. Međutim, kada bi naučnici tu stali, njihovi radovi nikada ne bi bili spomenuti u udžbenicima statistike. Istraživači su otkrili još jedan obrazac unutar već spomenute potvrđene hipoteze. Oni su dokazali da vrlo visoki očevi imaju djecu koja su u prosjeku visoka, ali se ne razlikuju mnogo od djece čiji se očevi, iako su viši od prosjeka, ne razlikuju mnogo od prosječne visine. Isto važi i za očeve vrlo niskog rasta (odstupajući od prosjeka niske grupe) - njihova djeca se u prosjeku nisu razlikovala po visini od vršnjaka čiji su očevi jednostavno bili niski. Nazvali su funkciju koja opisuje ovaj obrazac regresijska funkcija. Nakon ove studije, sve jednadžbe koje opisuju slične funkcije i konstruirane na sličan način počele su se nazivati regresijskim jednadžbama.

Regresiona analiza je jedna od metoda multivarijantne statističke analize podataka, koja kombinuje skup statističkih tehnika dizajniranih za proučavanje ili modeliranje odnosa između jedne zavisne i nekoliko (ili jedne) nezavisnih varijabli. Zavisna varijabla, prema tradiciji prihvaćenoj u statistici, naziva se odgovor i označava se kao V Nezavisne varijable se nazivaju prediktori i označavaju se kao X. Tokom analize će se utvrditi da su neke varijable slabo povezane sa odgovorom i na kraju će biti isključene iz analize. Preostale varijable povezane sa zavisnom varijablom se također mogu nazvati faktorima.

Regresiona analiza omogućava predviđanje vrijednosti jedne ili više varijabli ovisno o drugoj varijabli (na primjer, sklonost ka nekonvencionalnom političkom ponašanju ovisno o nivou obrazovanja) ili nekoliko varijabli. Računa se na računaru. Za kreiranje regresione jednadžbe koja vam omogućava da izmjerite stupanj ovisnosti kontrolirane karakteristike od faktorskih, potrebno je uključiti profesionalne matematičare i programere. Regresiona analiza može pružiti neprocjenjivu uslugu u konstruiranju prediktivnih modela razvoja političke situacije, procjeni uzroka društvenih tenzija i pri izvođenju teorijskih eksperimenata. Regresiona analiza se aktivno koristi za proučavanje uticaja niza socio-demografskih parametara na biračko ponašanje građana: pol, starost, profesija, mesto stanovanja, nacionalnost, nivo i priroda prihoda.

U odnosu na regresijsku analizu koriste se koncepti nezavisni I zavisan varijable. Nezavisna varijabla je ona koja objašnjava ili uzrokuje promjenu druge varijable. Zavisna varijabla je varijabla čija se vrijednost objašnjava utjecajem prve varijable. Na primjer, na predsjedničkim izborima 2004. godine odlučujući faktori, tj. nezavisne varijable bili su indikatori kao što su stabilizacija finansijske situacije stanovništva zemlje, nivo popularnosti kandidata i faktor dužnost. Zavisnom varijablom u ovom slučaju može se smatrati procenat glasova datih za kandidate. Slično, u paru varijabli “dob birača” i “nivo izborne aktivnosti” prva je nezavisna, a druga zavisna.

Regresiona analiza vam omogućava da riješite sljedeće probleme:

- 1) utvrdi samu činjenicu postojanja ili odsustva statistički značajne veze između Ki X;

- 2) konstruisati najbolje (u statističkom smislu) procene funkcije regresije;

- 3) prema datim vrednostima X izgraditi prognozu za nepoznato U

- 4) vrednovati specifična težina uticaj svakog faktora X on U i shodno tome isključiti nebitne karakteristike iz modela;

- 5) identifikujući uzročne veze između varijabli, djelimično kontroliraju vrijednosti P regulacijom vrijednosti eksplanatornih varijabli X.

Regresiona analiza je povezana sa potrebom odabira međusobno nezavisnih varijabli koje utiču na vrijednost indikatora koji se proučava, utvrđivanja oblika regresione jednačine i procjene parametara koristeći statističke metode obrada primarnih socioloških podataka. Ova vrsta analize zasniva se na ideji oblika, smjera i bliskosti (gustine) odnosa. Razlikovati parna soba I višestruka regresija zavisno od broja karakteristika koje se proučavaju. U praksi se regresiona analiza obično izvodi zajedno sa korelacionom analizom. Jednačina regresije opisuje numerički odnos između veličina, izražen kao tendencija da se jedna varijabla povećava ili smanjuje dok se druga povećava ili smanjuje. Istovremeno su ljuti frosty I nelinearna regresija. Kada se opisuju politički procesi, obje regresijske opcije se podjednako nalaze.

Scatterplot za distribuciju međuzavisnosti interesa u člancima o političke teme (U) i edukacija ispitanika (X) predstavlja linearnu regresiju (slika 30).

Rice. 30.

Scatter dijagram za distribuciju nivoa izborne aktivnosti ( U) a starost ispitanika (A) (uslovni primjer) je nelinearna regresija (Sl. 31).

Rice. 31.

Da bi se opisao odnos između dvije karakteristike (A" i U) u modelu uparene regresije, koristi se linearna jednadžba

![]()

gdje a, - slučajna varijabla greške jednačine kada karakteristike variraju, tj. odstupanje jednačine od “linearnosti”.

Za procjenu koeficijenata A I b koristite metodu najmanjih kvadrata, koja pretpostavlja da zbir kvadrata odstupanja svake tačke na dijagramu raspršenja od linije regresije treba biti minimalan. Odds a h b može se izračunati pomoću sistema jednačina:

Metoda procjene najmanjih kvadrata daje procjene koeficijenata kao što su A I b, za koje prava prolazi kroz tačku sa koordinatama X I y, one. postoji veza at = sjekira + b. Grafičko predstavljanje regresiona jednačina se zove teorijska regresijska linija. Uz linearnu zavisnost, koeficijent regresije predstavlja na grafu tangentu ugla nagiba teorijske regresijske linije prema apscisi. Znak koeficijenta ukazuje na smjer odnosa. Ako je veći od nule, onda je veza direktna, ako je manja, inverzna je.

Donji primjer iz studije „Politički Petersburg-2006“ (Tabela 56) pokazuje linearnu vezu između ideja građana o stepenu zadovoljstva svojim životom u sadašnjosti i očekivanja promjena u kvaliteti života u budućnosti. Odnos je direktan, linearan (standardizovani koeficijent regresije je 0,233, nivo značajnosti je 0,000). U ovom slučaju, koeficijent regresije nije visok, ali ga premašuje donja granica statistički značajan pokazatelj (donja granica kvadrata statistički značajnog pokazatelja Pirsonovog koeficijenta).

Tabela 56

Utjecaj kvaliteta života građana u sadašnjosti na očekivanja

(Sankt Peterburg, 2006.)

* Zavisna varijabla: „Šta mislite kako će se vaš život promijeniti u naredne 2-3 godine?“

U političkom životu vrijednost varijable koja se proučava najčešće zavisi istovremeno od nekoliko karakteristika. Na primjer, na nivo i prirodu političke aktivnosti istovremeno utiču politički režim države, političke tradicije, karakteristike političko ponašanje ljudi datog područja i društvenu mikrogrupu ispitanika, njegovu starost, obrazovanje, nivo prihoda, političku orijentaciju itd. U ovom slučaju potrebno je koristiti jednačinu višestruka regresija, koji izgleda ovako:

gdje je koeficijent b.- koeficijent parcijalne regresije. Pokazuje doprinos svake nezavisne varijable određivanju vrijednosti nezavisne (ishodne) varijable. Ako je koeficijent parcijalne regresije blizu 0, onda možemo zaključiti da ne postoji direktna veza između nezavisnih i zavisnih varijabli.

Proračun takvog modela može se izvesti na PC-u pomoću matrične algebre. Višestruka regresija nam omogućava da odrazimo multifaktorsku prirodu društvenih veza i razjasnimo uticaj svakog faktora posebno i svih zajedno na rezultirajući atribut.

Koeficijent označen sa b, naziva se koeficijent linearne regresije i pokazuje jačinu veze između varijacije faktorske karakteristike X i varijacije rezultirajuće osobine Y Ovaj koeficijent mjeri snagu odnosa u apsolutnim jedinicama mjerenja osobina. Međutim, bliskost korelacije između karakteristika može se izraziti i u proporcijama standardne devijacije rezultirajuće karakteristike (ovaj koeficijent se naziva koeficijent korelacije). Za razliku od koeficijenta regresije b koeficijent korelacije ne zavisi od prihvaćenih mernih jedinica karakteristika, pa je stoga uporediv za bilo koju karakteristiku. Obično se veza smatra jakom ako je / > 0,7, srednje blizu - na 0,5 g 0,5.

Kao što je poznato, najbliža veza je funkcionalna veza, kada je svaka pojedinačna vrijednost Y može se nedvosmisleno pripisati značenju X. Dakle, što je koeficijent korelacije bliži 1, to je odnos bliži funkcionalnom. Nivo značajnosti za regresionu analizu ne bi trebalo da prelazi 0,001.

Koeficijent korelacije se dugo smatrao glavnim pokazateljem bliskosti odnosa između karakteristika. Međutim, kasnije je koeficijent determinacije postao takav pokazatelj. Značenje ovog koeficijenta je sljedeće - on odražava udio ukupne varijanse rezultirajuće karakteristike U, objašnjeno varijansom osobine X. Nalazi se jednostavnim kvadriranjem koeficijenta korelacije (koji varira od 0 do 1) i, zauzvrat, za linearna veza odražava udio od 0 (0%) do 1 (100%) karakteristične vrijednosti Y, određena karakterističnim vrijednostima X. Napisano je kao ja 2, a u rezultirajućim tabelama regresione analize u SPSS - bez kvadrata.

Istaknimo glavne probleme u konstruisanju jednačine višestruke regresije.

- 1. Odabir faktora za uključivanje u jednadžbu regresije. U ovoj fazi, istraživač prvo sastavlja opšta lista glavni razlozi koji, prema teoriji, određuju fenomen koji se proučava. Zatim mora odabrati karakteristike u jednadžbi regresije. Osnovno pravilo odabira: faktori uključeni u analizu treba da koreliraju jedan s drugim što je manje moguće; samo u ovom slučaju se kvantitativna mjera uticaja može pripisati specifičnom faktoru-atributu.

- 2. Odabir oblika višestruke regresijske jednačine(u praksi se češće koristi linearna ili linearno-logaritamska). Dakle, da bi koristio višestruku regresiju, istraživač prvo mora izgraditi hipotetički model utjecaja nekoliko nezavisnih varijabli na ishod. Da bi rezultati bili pouzdani, potrebno je da model tačno odgovara realnom procesu, tj. odnos između varijabli mora biti linearan, nijedna značajna nezavisna varijabla se ne može zanemariti i nijedna varijabla koja nije direktno povezana sa procesom koji se proučava ne može biti uključena u analizu. Osim toga, sva mjerenja varijabli moraju biti izuzetno precizna.

Iz navedenog opisa proizilazi niz uslova za korištenje ove metode bez kojih je nemoguće pristupiti postupku višestruke regresione analize (MRA). Samo usklađenost sa svim sljedećim točkama omogućava vam da ispravno izvršite regresijsku analizu.